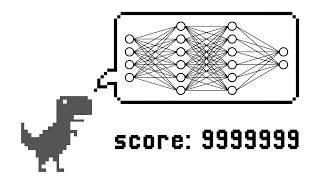

En este video, continúo con la introducción a Deep Learning y presento la forma jerárquica en la que una Red Neuronal Artificial abstrae información al procesar una imagen, haciendo la analogía con la forma en la que la corteza visual procesa datos. Así, se presenta un panorama general del funcionamiento de una red neuronal. En el siguiente video, se presentará el modelo matemático de una neurona artificial, la cual es el bloque fundamental para construir redes neuronales con muchas capas.

Acerca de la serie Fundamentos de Deep Learning con Python y PyTorch:

En esta serie de videos explico qué son las Redes Neuronales (Neural Networks) y qué es Aprendizaje Computacional (Machine Learning) así como Deep Learning. En los primeros videos, empezamos con los principios matemáticos fundamentales hasta llegar a su implementación en código. Para esto, primero utilizaremos Python y Numpy para entender los principios de programación de Redes Neuronales incluyendo el algoritmo de retropropagación (backpropagation). Con estas bases, presentaremos el framework PyTorch y construiremos modelos más complejos como son Redes Neuronales Convolucionales (Convolutional Neural Networks - CNNs).

About the video series:

In this video series I will explain what Neural Networks are, and how Deep Neural Networks work, from the mathematical principles to their implementation in code. Firstly, we will use pure Python and Numpy to understand the fundamentals including backpropagation for a simple Fully Connected Network, and from there we will build on to Convolutional Neural Networks (CNN) using PyTorch. I will be uploading at least one new video every week until we reach different architectures of CNNs. Then, depending on the response and interest in the series I may cover newer models using Generative Adversarial Networks (GANs), and Recurrent Neural Networks. Referencias:

Referencias:

- Deep Blue (chess computer)

https://en.wikipedia.org/wiki/Deep_Bl...)

- Fotografía de Deep Blue

James the photographer, CC BY 2.0, https://creativecommons.org/licenses/..., via Wikimedia Commons

- Hubel Dh, Wiesel Tn. “Receptive fields of single neurones in the cat's striate cortex,” J Physiol. 1959 Oct;148(3):574-91. doi: 10.1113/jphysiol.1959.sp006308. PMID: 14403679; PMCID: PMC1363130.

- Quiroga, R., Reddy, L., Kreiman, G. et al. “Invariant visual representation by single neurons in the human brain,” Nature 435, 1102–1107 (2005). https://doi.org/10.1038/nature03687

- M. D. Zeiler and R. Fergus, “Visualizing and Understanding Convolutional Networks,” arXiv:1311.2901 [cs], Nov. 2013, Accessed: Jan. 29, 2021. [Online]. Available: http://arxiv.org/abs/1311.2901.

- K. Simonyan, A. Vedaldi, and A. Zisserman, “Deep Inside Convolutional Networks: Visualising Image Classification Models and Saliency Maps,” arXiv:1312.6034 [cs], Apr. 2014, Accessed: Jan. 07, 2021. [Online]. Available: http://arxiv.org/abs/1312.6034.

- H. Zhang, Y. N. Dauphin, and T. Ma, “Fixup Initialization: Residual Learning Without Normalization,” arXiv:1901.09321 [cs, stat], Mar. 2019, Accessed: Jan. 09, 2020. [Online]. Available: http://arxiv.org/abs/1901.09321.

Информация по комментариям в разработке